KI-gesteuerte Gesichtsanimation

Inhaltsverzeichnis

- 🎮 Einführung

- 📝 Überblick über die Unreal Engine und NVIDIA-Technologien

- 🛠️ Installation von Omniverse und Audio-to-Face

- 📥 Herunterladen und Installieren von Omniverse

- 🎶 Installation von Audio-to-Face

- 🖥️ Konfiguration von Audio-to-Face

- ⚙️ Einstellungen für den Exporter

- 🧩 Hinzufügen der Pythonizc-Bibliothek

- 🔄 Einrichtung der Animationsskripte

- 📝 Bearbeitung des Fax-Solver-Skripts

- 📤 OSC-Kommunikation mit Unreal Engine

- 🎭 Durchführung der Animation

- 🕹️ Übertragung der Blendformen

- 🎬 Einrichtung des Animation Blueprints

- 📋 Zusammenfassung und Fazit

- ✅ Überprüfung und Feinanpassung

- ❓ Häufig gestellte Fragen (FAQs)

🎮 Einführung

In dieser Anleitung werden wir untersuchen, wie man in der Unreal Engine mithilfe der NVIDIA-Technologie eine Live-Verbindung erstellt. Insbesondere werden wir uns darauf konzentrieren, wie man die Audio-to-Face-Technologie integriert, um lebendige Metamenschen zu animieren.

🛠️ Installation von Omniverse und Audio-to-Face

Bevor wir beginnen können, müssen wir Omniverse von NVIDIA herunterladen und installieren. Anschließend installieren wir das Audio-to-Face-Plugin, das für unsere Animationen erforderlich ist.

🖥️ Konfiguration von Audio-to-Face

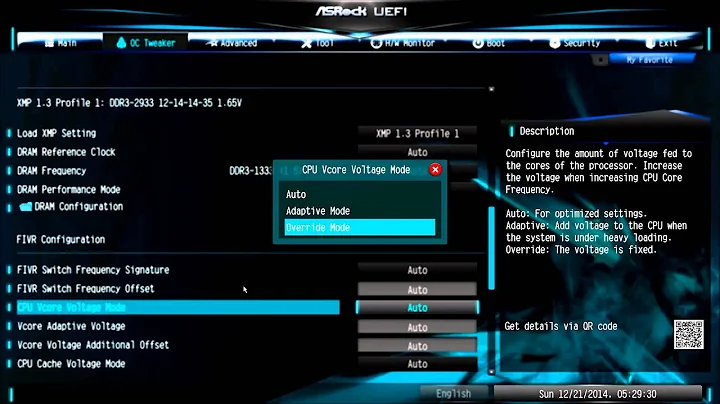

Wir werden die Einstellungen für den Exporter anpassen und sicherstellen, dass alle erforderlichen Bibliotheken korrekt installiert sind, um eine reibungslose Integration zu gewährleisten.

🔄 Einrichtung der Animationsskripte

Mit Hilfe von Skripten werden wir die Kommunikation zwischen Audio-to-Face und Unreal Engine einrichten, um die Animationen synchronisiert und in Echtzeit abzuspielen.

🎭 Durchführung der Animation

Hier führen wir die eigentliche Animation durch, indem wir die Blendformen übertragen und das Animation Blueprint in Unreal Engine konfigurieren.

📋 Zusammenfassung und Fazit

Abschließend überprüfen wir unsere Arbeit und passen bei Bedarf Parameter an, um sicherzustellen, dass unsere Animationen den gewünschten Effekt erzielen.

❓ Häufig gestellte Fragen (FAQs)

Frage: Was ist die Audio-to-Face-Technologie?

Antwort: Die Audio-to-Face-Technologie nutzt maschinelles Lernen, um Gesichtsanimationen basierend auf dem Audiotrack zu generieren.

Frage: Gibt es Einschränkungen bei der Echtzeitsynchronisierung?

Antwort: Zum Zeitpunkt der Aufnahme dieses Tutorials unterstützte Audio-to-Face keine Echtzeitsynchronisierung. Es erforderte einige Anpassungen, um dies zu erreichen.

Frage: Kann diese Technologie auch in anderen Projekten verwendet werden?

Antwort: Ja, die Integration von Audio-to-Face in Unreal Engine ist vielseitig einsetzbar und kann in verschiedenen Projekten genutzt werden, die lebendige Animationen erfordern.

WHY YOU SHOULD CHOOSE TOOLIFY

WHY YOU SHOULD CHOOSE TOOLIFY